Forscherinnen am KIT (Karlsruher Institut für Technologie) ist es in Zusammenarbeit mit us-amerikanischen Wissenschaftlerinnen gelungen, aus Gehirnströmen Sprache abzuleiten. Brain-to-Text. Klingt wie Science-Fiction, jenseits von allem, was in der Richtung Brain-Computer Interface sonst so machbar ist. Wie kann sowas mit einem hochkomplexen Muster wie Sprache gehen? Ich stand der Meldung zunächst entsprechend skeptisch gegenüber.

Nun ist das KIT allerdings nicht irgendein ausgedachtes Institut, sondern laut Wikipedia eine der besten technischen Universitäten Europas. Es spricht also viel dafür, dass an der Sache was dran ist.

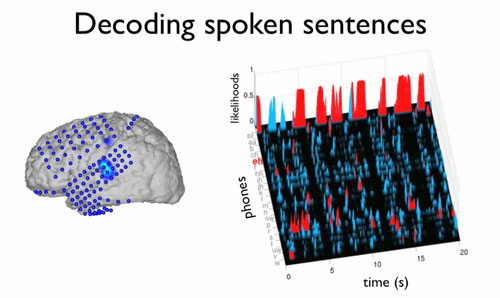

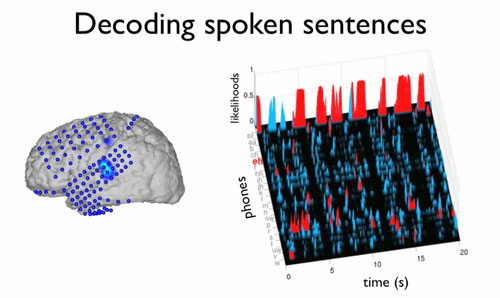

Netterweise lässt sich die dazugehörige Studie im Volltext online abrufen. Das Video macht’s leider nicht unbedingt klarer, ich musste mich also wohl oder übel durch den Volltext kämpfen.

Was mir aufgefallen ist: Das Auslesen hat nicht bei allen Probandinnen gleich gut geklappt. Für die Studie mussten die Probandinnen hörbar sprechen. Außerdem lagen dabei die auslesenden Elektroden nicht außen am Kopf, sondern direkt auf der Hirnrinde. Darüber hinaus wurde die Komplexität des Sagbaren, das Vokabular, massiv eingeschränkt. Klingt in der Form nicht wirklich nützlich, ist aber wichtige Grundlagenforschung. Man weiß jetzt, dass Sprache und Laute in Hirnströmen codiert sind und diese lassen sich auslesen.

Die Auswirkungen von Brain-to-Text lassen sich kaum überschätzen. Die Forscherinnen gehen zum Beispiel davon aus, dass ihr Experiment auch real-time Online-Kommunikation ermöglicht oder Menschen helfen kann, die am Locked-In-Syndrom leiden.

Fun Fact: Zu den vorgelesenen Texten gehörte neben der Antrittsrede JFKs unter anderem auch Charmed-Fan-Fiction.